AIモデル開発向け マシン選定のポイント

高性能GPUや開発環境の充実により、AIモデル開発でのPC需要が増加しています。

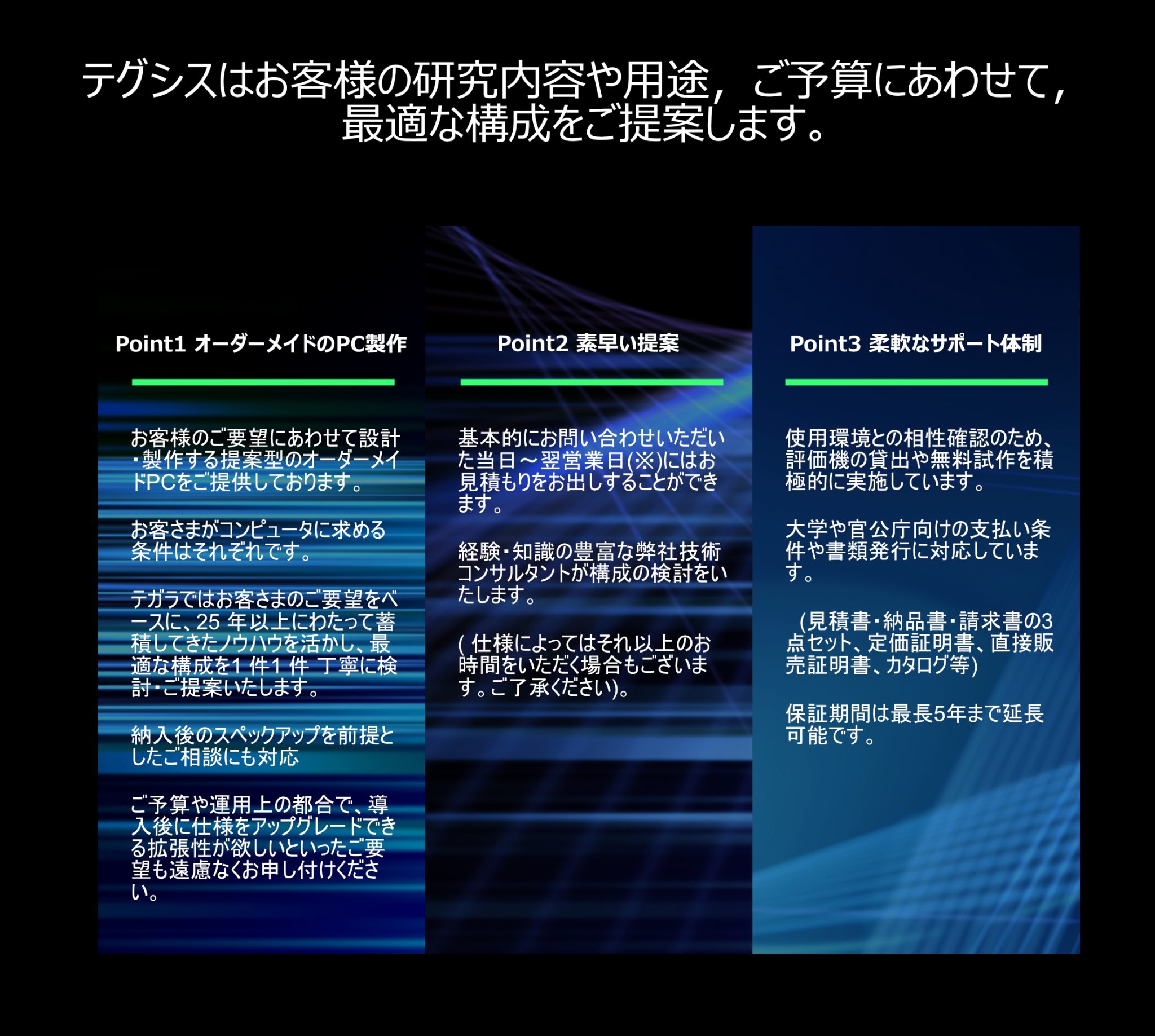

テガラでは、お客様ごとの条件にあわせて、最適なマシン構成をご提案いたします。

「学習」と「推論」におけるPC要件の違い

AIモデル開発には、大きく「学習」と「推論」の2つのフェーズがあります。学習はモデル生成、推論は学習済みモデルを実際に利用する過程です。

一般的な機械学習の流れは、「学習」→「推論」の順番で行われます。

「学習」と「推論」

| 学習 | 学習は、大量のトレーニングデータからモデルを学習させる過程です。モデルを適応させるためにパラメータを調整していきます。 |

| 求められるPCスペック:高性能で大容量なPC(多コアCPU・多コアGPU・大容量メモリ)が必要。 | |

| 推論 |

推論は、学習済みモデルに新しい入力データを与えて予測や分類を行う過程です。学習時ほどのスペックは必要とされませんが、推論に特化したチップや専用AIプロセッサも利用可能です。 |

| 求められるPCスペック:学習時より小規模なPCでも十分に利用できる。 |

「AIモデル開発用のPC」は、学習フェーズ用のマシンと言い換えることができ、全体的に高性能なマシンが求められます。

では、AIモデル開発の環境についてもう少し詳しく見ていきましょう。

AIモデル開発でよく使われるソフトウェア環境

AIモデルの開発に使用されるソフトウェアのうち、代表的な物をご紹介します。

|

AI開発に最も用いられるプログラミング言語です。 |

|

|

深層学習のフレームワークで、多くのアプリケーション開発で利用されています。 |

|

|

効率的なAI開発を行うためのノート型IDEで、便利に活用できます。 |

|

|

NVIDIA社製品によるGPGPUを利用、実装するための開発環境で各種ライブラリやコンパイラなどが提供されます。NVIDIA社製品をGPGPUに利用する基盤となるツール群です。 |

|

| NVIDIA cuDNN |

AI開発で利用されるdeep neural networkを実装するためのライブラリです。CUDA Toolkitと合わせて利用することが前提となります。 |

AIモデル学習においては、CUDA Toolkitが積極的に利用されています。

CUDAはGPUの能力を最大限に活用し、複雑な数値演算を並列処理できるため、AIモデルの学習時間を大幅に短縮し、効率的なリソース活用を可能とします。また、CUDA Toolkitは多くの深層学習フレームワーク (TensorFlowやPyTorch)と統合されており、これらのフレームワークをGPUで高速に動作させるためのインターフェースを提供します。この統合性と高いパフォーマンスにより、CUDA ToolkitはAIモデル学習でのデファクトスタンダートとなっています。

PythonでのAI開発の基本的なステップ

| 1 | データセットの準備 |

トレーニングデータやテストデータを収集し、DataFrameなどにロードします。 |

| 2 | モデルの実装 |

モデルの実装:TensorFlowやPyTorchを使用して学習モデルを実装します。 |

| 3 | モデルの学習 |

モデルの学習:準備したデータセットを使用して、モデルパラメータの学習を行います。 |

| 4 | モデルの評価 |

テストデータセットでモデルの性能を評価し、精度などを確認します。 |

| 5 | モデルの改善 |

評価結果を元にモデル構造の最適化を行い、性能向上を目指します。 |

| 6 | モデルの保存・再学習 | 学習済みモデルを保存し、新しいデータセットで再学習できるようにします。 |

| 7 | 推論の実行 |

推論用コードを実装・保存し、新規データで推論を実行します。 |

これらのステップを踏むことで、使った機械学習・Deep Learningモデルの開発が可能です。

プロジェクトに応じてステップの詳細を工夫し、進めていくことが重要です。

AIモデル開発を行うPCに求められるスペック

AIモデルの開発を行うために必要なPCスペックを、具体的に見ていきましょう。

学習させる内容や量などによって差異はありますが、一般的な水準での目安としては以下のようなスペックが考えられます。

|

CPU |

多コアCPUが選択されることが多いです。 |

|

GPU |

NVIDIAのGPUを搭載することが一般的で、GPUのコア数・メモリ容量が多いほど処理が高速になります。 |

|

メモリ |

搭載GPUに応じた容量のメモリが必要で、これにより大規模モデルのトレーニングが可能になります。 |

|

ストレージ |

SSDを使用することで、HDDよりも高速かつ効率的なデータ処理が可能です。 |

|

OS |

Linuxを使用し、Ubuntuが利用されることが多いです。これは、Ubuntuをサポートするライブラリが多いことによります。 |

高性能なCPU、多くのGPUコア、大容量のメモリを搭載することでAIモデル開発をスムーズに行うことができます。

また、扱う予定のデータ量に応じて適切なPCスペックを検討してください。

AIモデル開発 / DeepLearning 入門用構成例

テグシスでは、AI開発や機械学習・DeepLearningを行うお客様へ、数多くのPC構成をご提案してきました。

以下はその代表的な事例ですが、WEBに掲載のない用途・構成でもお気軽にご相談ください。

長年の実績から、最適な構成をご提案します。

オススメ構成例

過去の提案事例

|

|

|

|||||||||||||||||||||

|

|

|

|||||||||||||||||||||

|

|||||||||